嵌入式系统集成Anything to RealCharacters 2.5D引擎方案

本文介绍了在星图GPU平台上自动化部署📸 Anything to RealCharacters 2.5D转真人引擎的方案。该方案旨在将这一强大的AI图像生成能力集成到资源受限的嵌入式设备中,实现本地化的图片生成与转换,典型应用如智能相框可将用户上传的动漫角色图片实时转换为栩栩如生的真人肖像,兼顾隐私安全与实时体验。

嵌入式系统集成Anything to RealCharacters 2.5D引擎方案

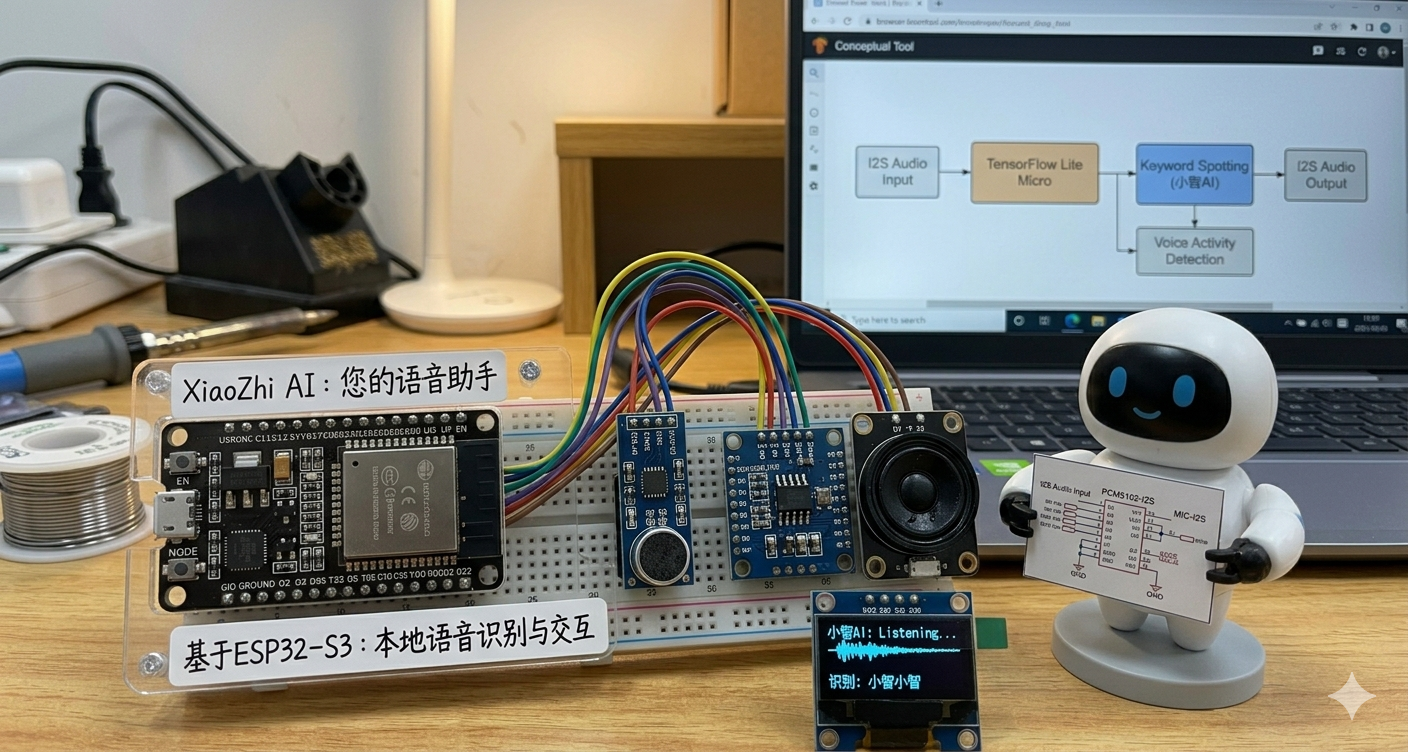

想象一下,你正在开发一款智能相框或者一个带屏幕的智能家居中控。用户上传了一张自己喜爱的动漫角色图片,屏幕上的设备几乎在瞬间,就把这个卡通形象转换成了一个栩栩如生的真人照片。这种“魔法”般的体验,背后需要的正是将强大的AI图像生成引擎塞进资源有限的嵌入式设备里。

今天要聊的,就是把“Anything to RealCharacters”这个能把二次元、2.5D角色变成真人的引擎,集成到嵌入式系统中的实战思路。这不像在服务器上部署那么简单,你得考虑内存只有几百兆、处理器性能有限、还得省电的现实情况。下面,我们就来拆解一下,怎么让这个“大家伙”在“小盒子”里也能跑起来。

1. 为什么要在嵌入式设备上做这个?

你可能首先会问,这种AI模型通常都在云端或者高性能PC上运行,为什么非要折腾到嵌入式设备里?这背后有几个很实在的原因。

首先是隐私与数据安全。用户的照片,尤其是生成真人肖像,是非常敏感的个人数据。如果所有图片都要上传到云端处理,用户会担心数据泄露的风险。在设备本地完成所有计算,数据不出设备,从根本上解决了这个顾虑。

其次是实时性与离线可用。很多嵌入式设备的使用场景对网络依赖度低,或者要求即时响应。比如一个带摄像头的智能门铃,如果能本地实时将访客的卡通头像(如预设形象)转换为更易识别的真人预览,体验会流畅很多。离线状态下,功能也不受影响。

最后是成本与可扩展性。对于量产设备,如果每处理一张图片都需要调用云端API,长期来看是一笔不小的持续开销。本地集成虽然增加了单台设备的硬件成本(主要是更强的算力芯片),但摊薄了运营成本,也更利于产品功能的独立性和定制化开发。

当然,挑战也显而易见。嵌入式环境通常意味着有限的CPU/GPU算力、紧张的内存(RAM)和存储空间,以及对功耗和发热的严格限制。直接把为RTX 4090设计的模型搬过来是行不通的,我们必须进行一场“瘦身”和“优化”手术。

2. 核心挑战与解决思路

把Anything to RealCharacters引擎塞进嵌入式设备,我们主要面临三大难关:模型太大跑不动、计算太慢等不起、耗电太多扛不住。针对这三点,我们有相应的技术手段来应对。

2.1 模型资源优化:给AI模型“瘦身”

原版的AI模型动辄几个GB,对于嵌入式存储来说是难以承受之重。我们的目标是将其压缩到百兆甚至几十兆级别。

模型量化是最常用且有效的一招。简单说,就是把模型计算中的高精度数字(比如32位浮点数)转换成低精度格式(比如8位整数)。这就像把一张高清无损图片转换成高质量的JPEG,肉眼几乎看不出差别,但文件大小能缩小好几倍。经过量化,模型体积能减少到原来的1/4,同时推理速度也能提升。

# 示例:使用ONNX Runtime进行模型量化(概念性代码)

import onnx

from onnxruntime.quantization import quantize_dynamic, QuantType

# 加载原始FP32模型

model_fp32 = ‘anything_to_real.onnx’

# 执行动态量化

quantize_dynamic(model_fp32, ‘anything_to_real_int8.onnx’, weight_type=QuantType.QInt8)

print(“模型量化完成,体积大幅减小。”)

模型剪枝是另一招。你可以理解为给模型做“减法”,去掉那些对最终输出结果影响微乎其微的神经元连接。通过分析模型,我们发现有些参数总是接近零,这些“冗余”部分可以被安全地裁剪掉,从而得到一个更精简、更高效的网络结构。

知识蒸馏则有点“老师教学生”的味道。我们用一个庞大而精确的原始模型(老师)来训练一个小巧的模型(学生)。学生模型虽然结构简单,但通过学习老师模型的“行为”和“决策逻辑”,也能达到接近老师的性能水平,完美适配嵌入式设备。

2.2 计算实时性保证:让推理“飞起来”

光模型小还不够,还得算得快。在嵌入式环境下,我们需要充分利用有限的硬件资源。

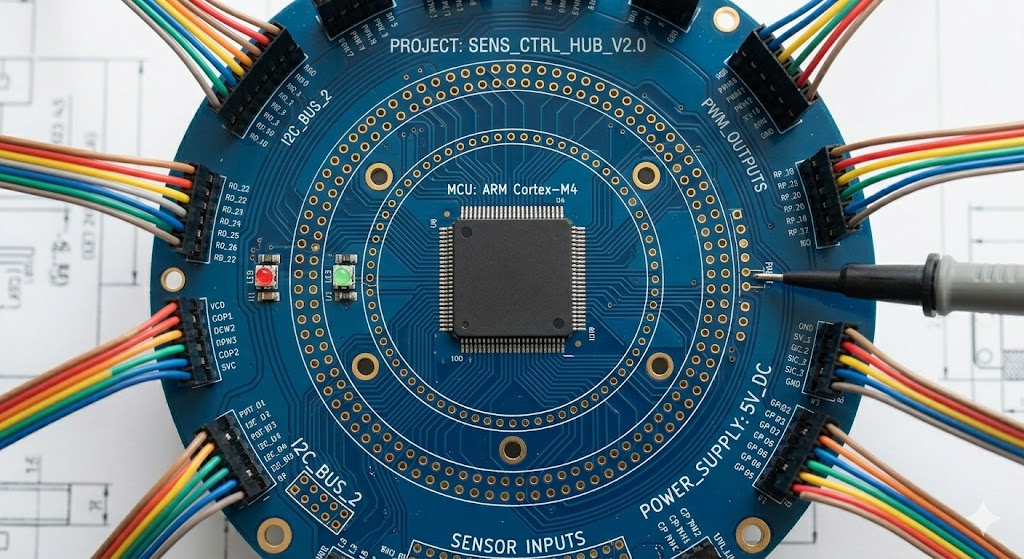

硬件加速器选型是关键第一步。如今,许多嵌入式SoC都集成了专用的NPU(神经网络处理单元)或强大的GPU。例如,一些高端的嵌入式平台,其NPU的算力足以在秒级甚至亚秒级完成一次中等复杂度的图像生成推理。选择支持这些加速器的模型框架(如TensorFlow Lite、OpenVINO、NVIDIA TensorRT for Jetson)至关重要。

计算图优化与算子融合是软件层面的加速手段。推理框架在加载模型时,会对模型的计算过程进行重新组织和优化,把多个细小的计算步骤合并成一个大的核函数,减少内存访问开销和内核启动次数,从而显著提升执行效率。

流水线与异步处理是从系统设计角度提升响应速度。我们可以把整个“图生图”流程拆解:图像解码、预处理、AI推理、后处理、图像编码。让这些步骤像工厂流水线一样重叠进行。当第一张图在进行AI推理时,第二张图的预处理已经开始了,这样整体吞吐量就上去了,用户感觉延迟更低了。

2.3 低功耗与热设计:既要马儿跑,又要马儿少吃草

嵌入式设备很多是电池供电或长期在线,功耗直接关系到续航和稳定性。

动态电压频率缩放是芯片自带的本领。当系统检测到AI引擎空闲或负载较低时,会自动降低处理器核心的工作电压和频率,从而大幅降低功耗。一旦有任务到来,又能迅速“满血”工作。

任务调度与休眠策略需要我们在软件层面精心设计。不是每时每刻都需要进行图像转换。我们可以设计一个智能调度器,将多个转换请求集中起来批量处理,处理完成后让AI计算单元进入深度休眠。而不是来一张图就唤醒一次,频繁唤醒的功耗代价很高。

散热设计也不容忽视。持续的高强度AI计算会产生热量。在结构设计上,可能需要考虑使用散热片、导热硅胶垫,甚至小型风扇(在功耗允许的情况下)。良好的散热能防止芯片因过热而降频,保证长期运行的性能稳定。

3. 一个参考的集成方案架构

说了这么多思路,我们来看一个可能的具体方案架构。这个架构分为几个层次,从上到下协同工作。

应用层:这是用户能直接接触到的部分,比如设备上的一个拍照APP、一个图片浏览功能,或者一个设置卡通头像的界面。它负责接收用户的图片输入,并展示最终生成的真人效果图。

AI引擎服务层:这是核心中间层。它封装了优化后的Anything to RealCharacters模型。它提供简单的API接口给应用层调用,比如 generate_realistic_portrait(image_data)。在这一层内部,它管理着模型的加载、推理任务的队列、以及硬件加速器的调用。

运行时与框架层:这是让模型能在特定硬件上跑起来的软件基础。例如,如果你用的是支持ARM NPU的开发板,可能会选择TFLite配合厂商的NPU插件;如果用的是NVIDIA Jetson系列,那么TensorRT是最佳搭档。这一层负责将模型转换成硬件最“爱吃”的格式,并高效调度计算资源。

硬件层:这是所有功能的物理基础。我们需要选择一款算力足够的嵌入式主控。例如:

- 高端之选:搭载了专用NPU的AIoT芯片,算力可达几TOPS,能流畅运行优化后的模型。

- 均衡之选:集成中高端GPU的嵌入式平台,如某些系列,借助CUDA加速也能获得不错的效果。

- 成本敏感之选:利用多核CPU进行推理,虽然速度慢一些,但通过极致的模型压缩和优化,也能实现基本功能。

存储方面,eMMC或UFS用于存放系统、应用和模型;内存(LPDDR4/4X)则需要足够大,以确保大尺寸图片和模型中间数据能够流畅交换。

4. 实战开发要点与效果评估

在实际动手开发时,有几个点需要特别注意。

开发环境搭建:通常需要在x86的开发主机上安装交叉编译工具链。你会在主机上编译出能在ARM或其他嵌入式架构上运行的程序。模型优化和压缩的工作,大部分也在开发主机上完成,然后再部署到目标板进行最终测试。

性能 profiling 与调优:工具是你的好朋友。利用嵌入式平台提供的性能分析工具,你可以清楚地看到一次推理过程中,时间都花在哪里了——是数据预处理慢?还是模型某个算子特别耗时?针对瓶颈点进行优化,比如将某个预处理操作改用硬件加速,或者替换掉效率低下的算子实现。

效果与性能的平衡:这是贯穿始终的权衡。模型压缩得太狠,生成的照片可能模糊或有瑕疵;为了极致速度选用过低的分辨率,细节又会丢失。你需要针对你的具体产品定义(比如,智能相框要求高画质,可以接受3-5秒生成;而实时视频滤镜要求毫秒级响应,画质可以适当妥协),找到那个最佳的平衡点。可以准备一个测试集,包含各种风格的输入图,从卡通到2.5D,系统化地评估不同优化配置下的输出质量和速度。

内存使用监控:嵌入式系统内存泄漏是致命的。必须严格监控AI推理过程中的内存分配与释放,确保没有内存碎片和泄漏。特别是在连续处理多张图片时,内存使用应该保持在一个稳定的范围内。

5. 潜在的应用场景展望

当这项技术成功集成后,它能打开哪些有趣的嵌入式产品大门呢?

智能交互与娱乐设备:比如前面提到的智能相框,可以让家人的卡通合影“活”过来;儿童教育机器人,可以将故事书里的卡通角色变成真人形象进行互动,增强沉浸感。

个性化消费电子产品:智能手机或平板电脑的本地化特效相机,提供独特的“角色真人化”滤镜;游戏掌机或AR眼镜,允许玩家将自己的虚拟形象实时转换为更写实的风格。

专业与行业工具:便携式设计展示设备,让设计师能现场将概念草图快速渲染出真人模特效果;某些安防或身份识别设备的辅助功能,尝试将低清晰度或艺术化的参考图像转换为更易识别的真人样貌(需注意合规性)。

将Anything to RealCharacters这样的2.5D转真人引擎集成到嵌入式系统,确实是一个充满挑战但也极具价值的工程方向。它不仅仅是模型的简单移植,更是一场涉及算法优化、硬件适配、系统设计的综合考验。

从实践来看,关键在于“有的放矢”的优化。不要追求在嵌入式设备上复现云端的所有效果,而是针对你的核心应用场景,在模型大小、推理速度和生成质量之间找到一个完美的甜蜜点。现在嵌入式AI芯片的发展日新月异,算力越来越强,功耗越来越低,这让很多以前不敢想的事情变成了可能。

如果你正在规划一款带有屏幕和交互功能的智能嵌入式设备,不妨考虑加入这类AI图像生成能力,它可能会成为产品一个非常独特的亮点。当然,这条路需要扎实的工程实践和反复的调试优化,但带来的产品差异化和用户体验提升,无疑是值得的。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献36条内容

已为社区贡献36条内容

所有评论(0)