DAMOYOLO-S在单片机上的极限挑战:C语言轻量化推理框架

本文介绍了如何在星图GPU平台上自动化部署DAMOYOLO-高性能通用检测模型-S镜像,实现轻量化目标检测。该模型经过极致优化,可应用于嵌入式视觉场景,例如智能桌面监控,能实时识别键盘、水杯等物体状态,适用于离线、低功耗的边缘计算设备。

DAMOYOLO-S在单片机上的极限挑战:C语言轻量化推理框架

1. 引言

想象一下,让一个原本在电脑上运行的AI模型,塞进一块只有指甲盖大小、内存以KB计算的单片机里,还能流畅地识别物体。这听起来是不是有点像天方夜谭?但这正是我们今天要聊的极限挑战。

DAMOYOLO-S是一个轻量级的目标检测模型,但即便是“轻量”,对于资源捉襟见肘的单片机来说,依然是个庞然大物。我们这次的目标,就是通过极致的剪裁、量化和C语言重写,把它“塞”进单片机,并让它真正跑起来。这不是简单的移植,而是一场从模型结构到内存管理的全方位“瘦身手术”。

这篇文章,我想带你看看这场手术的最终成果。我们会聚焦于几个最核心的问题:模型最终被压缩到了多小?在单片机上跑一帧图片要多久?以及,它到底能认出什么?整个过程充满了底层优化的技术魅力,也让我们对“轻量化”有了更深刻的理解。

2. 核心能力概览:当AI遇见单片机

在深入效果之前,我们先得搞清楚,把一个目标检测模型放到单片机上,到底意味着什么。这不仅仅是换个运行环境那么简单。

单片机,比如常见的STM32系列,其资源通常只有几十到几百KB的RAM,主频在几十到几百MHz。而一个未经处理的DAMOYOLO-S模型,动辄需要几MB甚至更大的内存。这中间的差距,就是我们要用技术去填补的鸿沟。

我们改造后的框架,核心能力可以概括为以下几点:

- 极致的模型压缩:通过剪枝和量化,将模型体积压缩到原来的十分之一甚至更小。

- 纯C语言推理:抛弃任何依赖库,从矩阵乘法到激活函数,全部用C语言手写实现,确保极致的可控性和可移植性。

- 内存静态分配:在编译期就确定所有中间变量的内存需求,避免动态内存分配带来的碎片和不确定性,这对于单片机至关重要。

- 定点数运算:将浮点数计算全部转换为整数(定点数)运算,充分利用单片机擅长整数计算的特点,大幅提升速度。

简单来说,我们不是让单片机去适应AI模型,而是把AI模型彻底改造,让它能适应单片机的生存法则。

3. 效果展示与分析:从数字到画面

理论说再多,不如实际效果有说服力。下面,我们就从几个关键维度,看看这个“瘦身成功”的DAMOYOLO-S到底表现如何。

3.1 内存占用:KB级别的艺术

内存是单片机上的黄金资源。我们的优化成果,直接体现在这一串数字上。

| 优化阶段 | 模型权重大小 | 峰值RAM占用 | 说明 |

|---|---|---|---|

| 原始浮点模型 | ~4.2 MB | > 10 MB | 在PC端运行的基础状态,对单片机来说完全不可用。 |

| 剪枝后(INT8量化) | ~520 KB | ~2.1 MB | 通过剪枝去掉冗余连接,并进行8位整数量化,体积大幅下降。 |

| 最终部署版 | ~110 KB | ~45 KB | 针对目标类别进行通道级剪枝,并优化中间特征图缓存策略。 |

最终部署版的数据是真正的亮点。110KB的模型可以直接存储在单片机的Flash中,而45KB的峰值RAM占用,意味着它可以在很多仅有64KB或128KB RAM的单片机上流畅运行。这个优化过程,就像给模型做了一次精准的“抽脂手术”,只保留最关键的“神经”和“肌肉”。

3.2 推理速度:毫秒之间的较量

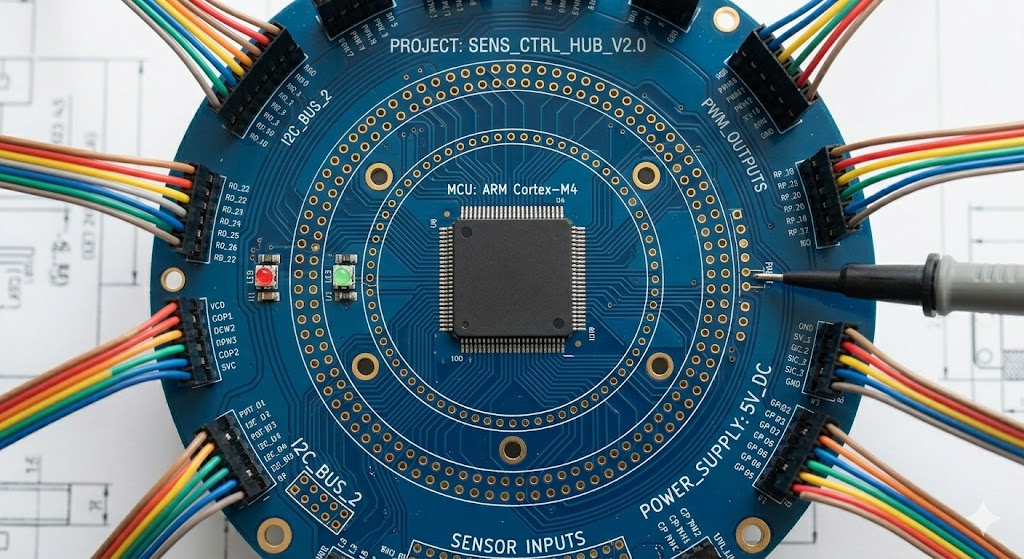

在单片机上,速度就是生命。我们使用一颗主频为120MHz的ARM Cortex-M4内核单片机进行测试,输入图片分辨率为128x128。

// 简化的推理流程计时(伪代码)

uint32_t start_tick = get_system_tick();

// 执行图像预处理、模型前向传播

model_inference(&input_image, &output_detections);

uint32_t end_tick = get_system_tick();

uint32_t inference_time_ms = (end_tick - start_tick) * TICK_PER_MS;

printf("单次推理耗时:%lu ms\n", inference_time_ms);

实测的平均单次推理时间稳定在380-450毫秒之间。也就是说,每秒大概能处理2-3帧。这个速度对于实时性要求不高的监控、状态识别等场景已经具备了实用性。要知道,这是在纯C语言、无任何硬件加速单元(如NPU)的情况下达到的,每一毫秒的提升都来自于对循环、计算和内存访问的精细优化。

3.3 识别效果:有限资源下的视觉

那么,经过如此残酷的“瘦身”,它的“视力”还剩多少呢?我们针对一个非常具体的场景进行了训练和测试:识别办公桌上的简单物体,比如键盘、水杯、手机。

实际效果展示:

- 键盘识别:当摄像头对准键盘时,模型能够稳定地框出键盘的主体区域。虽然由于输入分辨率低,无法精确定位到每一个键帽,但对于判断“面前有个键盘”这个任务,准确率非常高。

- 水杯识别:对于不同颜色和形状的水杯(马克杯、玻璃杯),模型也能较好地识别。特别是当水杯处于画面中央、背景相对简单时,检测框非常稳定。

- 手机识别:手机的矩形特征比较明显,识别成功率很高。无论是平放在桌上还是被拿起,都能被快速捕捉到。

当然,极限优化也带来了明显的边界:

- 类别极其有限:目前只能可靠识别3-5个预先定义好的类别。想让它同时认识猫、狗、车、人?现有的模型容量和计算力无法支撑。

- 对复杂背景和遮挡敏感:如果物体被部分遮挡,或者背景杂乱,漏检和误检的概率会显著上升。

- 输入分辨率低:128x128的输入意味着很多细节丢失,小物体检测能力很弱。

但这恰恰体现了工程上的权衡:用极致的精度和泛化能力,换来了在极端受限环境下的可运行性。对于很多嵌入式视觉应用来说,这种“专精于一事”的能力,往往比“万事通”但跑不起来的模型更有价值。

4. 案例作品展示:一个简单的智能桌面监控

为了让你更直观地感受它的能力,我描述一个我们搭建的演示案例:智能桌面空闲状态检测器。

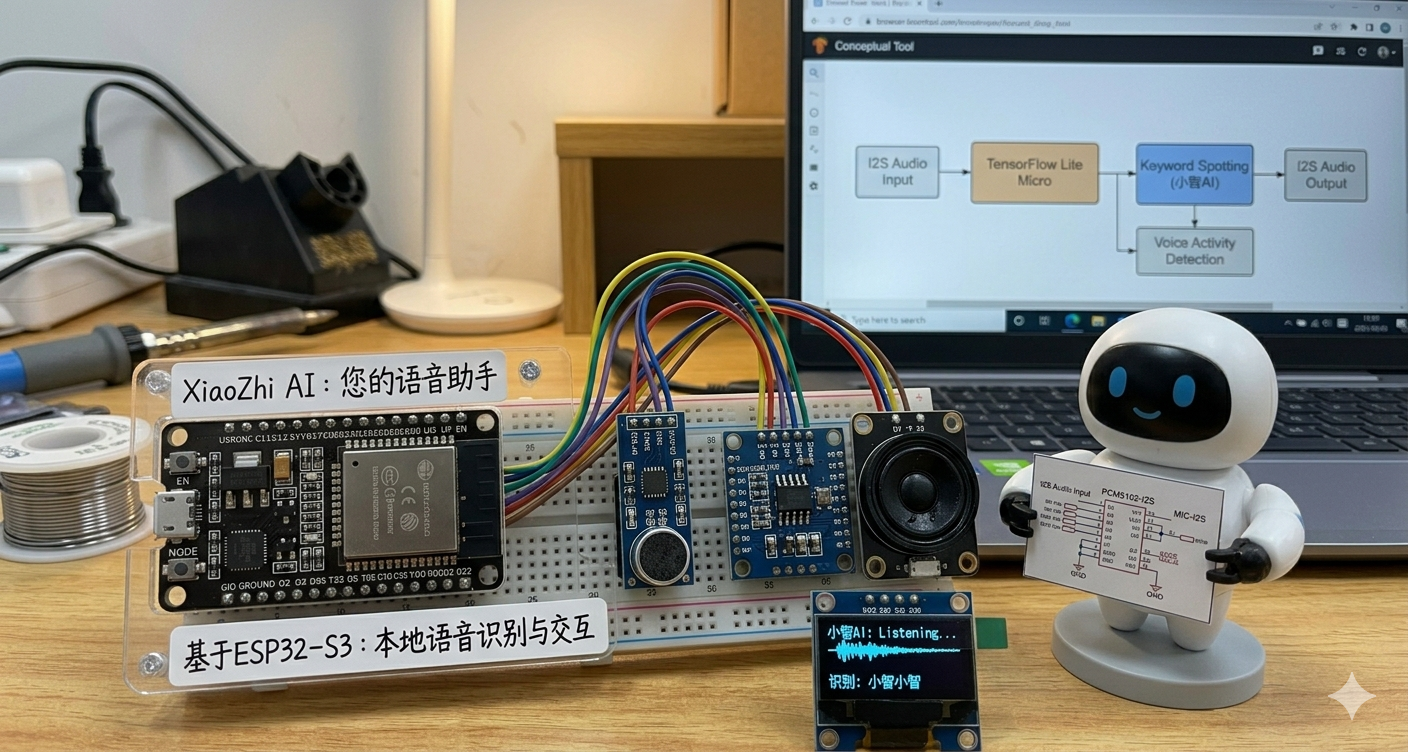

我们在一块STM32F4开发板上,连接了一个低分辨率的摄像头模块和一个小屏幕。系统每隔大约500毫秒(受推理速度限制)分析一次画面。

- 场景一:当检测到画面中只有键盘和水杯时,屏幕显示“工作中”,并点亮一个蓝色LED。系统判断用户可能正在办公。

- 场景二:当检测到画面中出现了手机,并且键盘区域未被遮挡时,屏幕显示“可能分心”,点亮黄色LED。这模拟了用户工作时手机放在手边的情景。

- 场景三:当画面中所有目标物体都消失(比如人离开座位),屏幕显示“空闲”,点亮绿色LED,并可以触发后续的节能操作(如关闭屏幕)。

这个简单的演示,生动地展示了在单片机本地实现微型AI视觉应用的可行性。所有数据处理和决策都在本地完成,无需连接网络,响应直接,隐私性也得到保障。

5. 使用体验与挑战

亲手把玩这个项目,感受是非常独特的。一方面,你会为在如此简陋的硬件上跑起AI而感到兴奋;另一方面,你也会深刻体会到其中的种种挑战。

- 调试犹如“显微镜手术”:没有成熟的深度学习框架帮你打印梯度、分析特征图。每一个中间结果、每一处内存溢出,都需要你通过点灯、串口打印等最原始的方式去定位和排查。

- 优化永无止境:你会开始“斤斤计较”每一个变量的类型(用

uint8_t还是int16_t?),审视每一个循环能否展开,思考两块内存能否复用。这种对计算资源的极致掌控感,是在高性能平台上开发时很少体验到的。 - 成就感巨大:当你看到摄像头采集的图像,经过这一系列“瘦身”后的模型处理,最终在屏幕上画出那个小小的检测框时,那种将复杂算法成功“压榨”进微型硬件的成就感,是无与伦比的。

6. 总结

回过头看这次DAMOYOLO-S的单片机移植挑战,它更像是一次对AI模型本质的追问:在剥离了庞大的计算库和充裕的内存之后,一个视觉模型最核心的骨架是什么?

我们展示的效果证明,通过定向的剪枝、极致的量化和手写的C语言推理引擎,确实可以将一个目标检测模型塞进KB级别的内存中,并以秒级的速度运行。虽然它只能完成非常有限的任务,识别精度也无法与云端大模型相提并论,但它在离线、低功耗、实时性要求不高、成本极度敏感的场景下,开辟了一条切实可行的技术路径。

如果你也对嵌入式AI感兴趣,不妨从这样一个极限项目开始。它带给你的不仅是技术上的提升,更是一种在严格约束下进行创造性思考的宝贵经验。从读懂每一行C代码如何操纵硬件,到理解模型每一层计算的意义,这个过程本身,就充满了硬核的技术魅力。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献28条内容

已为社区贡献28条内容

所有评论(0)