OFA模型C语言基础项目集成示例:轻量级嵌入式应用构想

本文探讨了将OFA模型能力轻量化集成到C语言嵌入式项目的构想。通过星图GPU平台,开发者可以自动化部署OFA图像描述-英文-通用领域-蒸馏33M镜像,高效完成模型的知识提取与规则抽象,从而为单片机等资源受限设备实现基础的图像识别与描述功能,例如在智能家居中识别特定物体。

OFA模型C语言基础项目集成示例:轻量级嵌入式应用构想

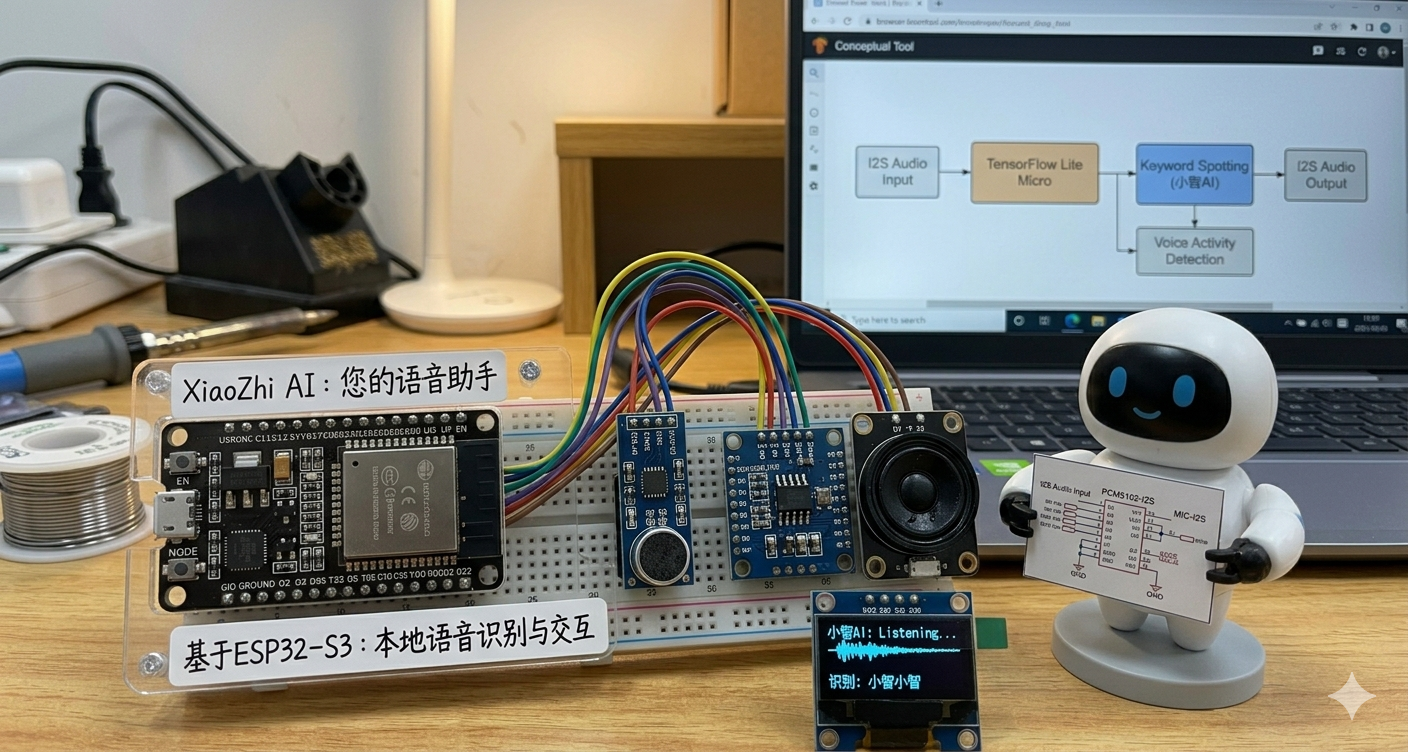

最近在捣鼓一些嵌入式项目,发现很多开发者对AI在单片机上的应用既好奇又觉得门槛太高。一提到AI模型,大家首先想到的就是Python、TensorFlow、PyTorch这些“重量级”选手,总觉得和资源紧张的C语言环境、单片机世界格格不入。

但实际情况可能没你想的那么复杂。今天我们不聊那些动辄几百MB的完整模型部署,而是换个思路:能不能把像OFA(One-For-All)这类多模态大模型的“核心思想”或者“简化成果”,用最基础的C语言,塞进一个小小的单片机里,让它也能具备一点“看懂图片并简单描述”的智能呢?

听起来有点天方夜谭?别急,这篇文章就是带你一起开开脑洞,从工程实践的角度,探讨一种轻量级集成的可能性。我们不会涉及复杂的模型训练和部署,而是聚焦于:如果你已经有了一个训练好的OFA模型(或者类似的视觉-语言模型),如何将其产出的、固化下来的“知识”或“规则”,用C语言实现,并运行在资源受限的嵌入式设备上。

我们的目标很明确:为你的下一个C语言嵌入式项目,增添一抹AI的亮色,而且是从零开始、手把手式的思路分享。

1. 核心思路:从“模型推理”到“规则执行”

首先,我们要彻底转变一个观念。在资源丰富的服务器或PC上,我们运行的是完整的OFA模型,它接受一张图片和一段文本提示,经过复杂的神经网络计算,输出对图片的描述。这个过程是“推理”,计算量大,需要浮点运算甚至GPU加速。

而在单片机(比如STM32系列、ESP32等)上,我们几乎不可能进行这种完整的模型推理。我们的思路是:将模型在云端或高性能设备上“推理”后得到的、针对特定任务的有效“模式”或“规则”,进行提取和简化,然后用C语言编码成确定性的逻辑。

举个例子:

- 完整模型:输入任意一张猫的图片,模型能输出“这是一只可爱的橘猫在沙发上睡觉”。

- 我们的轻量级方案:我们预先用大模型分析了成千上万张“猫”的图片,总结出一些关键特征规则(例如,检测到特定形状的轮廓、特定的颜色分布、特定的纹理模式等组合)。在单片机上,我们的C程序只负责用图像处理算法去检测这些预设的规则是否匹配。如果匹配,就输出预设好的描述文本:“检测到猫”。

这样一来,我们就把一个开放的、生成式的AI问题,转变为一个封闭的、基于规则的模式匹配问题。虽然能力上做了大幅简化(从“描述万物”到“识别特定几类事物”),但它在特定场景下(比如工业质检中的缺陷分类、智能家居中的简单物体识别)是可行且高效的。

1.1 技术路径构想

整个流程可以拆解为三个离线阶段和一个在线阶段:

- 知识提取(离线,在PC端完成):使用完整的OFA模型,对你关心的特定数据集(例如,“家电产品图”)进行推理。不直接使用其文本输出,而是分析其内部注意力机制或特征层,总结出区分不同类别(如“冰箱”、“洗衣机”、“空调”)的关键视觉特征模式。这些模式可能是轮廓、角点、颜色直方图、特定区域的纹理等低层次图像特征的组合。

- 规则抽象与量化(离线,在PC端完成):将上一步总结出的“模式”,翻译成一系列可量化的判断条件。例如:“如果图像中心区域HSV颜色空间的V值平均值大于200,且边缘检测后水平线条数量占比超过60%,则归类为‘冰箱’”。将这些规则参数化(阈值、比例等)。

- C代码实现(离线,开发阶段):将参数化的规则,用C语言实现。这包括:

- 图像预处理函数:裁剪、缩放、灰度化、二值化(用

uint8_t数组和循环搞定)。 - 特征提取函数:计算颜色直方图(遍历像素统计)、边缘检测(Sobel算子,用卷积核)、轮廓查找(简单的边界跟踪算法)。

- 规则判断函数:一堆

if-else或switch-case语句,根据提取的特征值与预设阈值进行比较,最终给出分类结果。

- 图像预处理函数:裁剪、缩放、灰度化、二值化(用

- 嵌入式端执行(在线,在单片机上运行):单片机通过摄像头模块获取图像,调用我们编写好的C函数库进行预处理、特征提取和规则判断,最终通过串口、LCD屏或网络输出结果:“识别到:冰箱”。

2. 一个极简的C语言示例框架

下面我们抛开复杂的OFA模型内部,直接构想一个用于“识别红色圆形物体”的超级简化版C项目框架。假设我们的“知识”已经提炼为一条规则:图像中红色像素聚集且形状接近圆形。

这个示例将展示如何在嵌入式C环境中组织代码。

// file: simple_ai_detector.h

#ifndef SIMPLE_AI_DETECTOR_H

#define SIMPLE_AI_DETECTOR_H

#include <stdint.h>

// 定义图像结构(假设从摄像头获取的是RGB565格式的数据)

typedef struct {

uint16_t* data; // 图像像素数据指针

int width;

int height;

} image_t;

// 识别结果枚举

typedef enum {

DETECT_NOTHING = 0,

DETECT_RED_CIRCLE,

DETECT_ERROR

} detection_result_t;

// 函数声明

void image_init(image_t* img, uint16_t* buffer, int w, int h);

detection_result_t detect_red_circle(const image_t* img);

#endif // SIMPLE_AI_DETECTOR_H

// file: simple_ai_detector.c

#include "simple_ai_detector.h"

#include <math.h> // 可能需要基础数学库,部分单片机需自行实现或使用简化版

// 初始化图像结构

void image_init(image_t* img, uint16_t* buffer, int w, int h) {

img->data = buffer;

img->width = w;

img->height = h;

}

// 从RGB565像素中提取R、G、B分量(简化版)

static void rgb565_to_rgb(uint16_t pixel, uint8_t* r, uint8_t* g, uint8_t* b) {

*r = (pixel >> 11) & 0x1F; // 5位红色

*g = (pixel >> 5) & 0x3F; // 6位绿色

*b = pixel & 0x1F; // 5位蓝色

// 简单缩放到0-255范围(可选,这里为演示)

*r = (*r * 255) / 31;

*g = (*g * 255) / 63;

*b = (*b * 255) / 31;

}

// 核心检测函数:寻找红色圆形区域

detection_result_t detect_red_circle(const image_t* img) {

if (!img || !img->data) return DETECT_ERROR;

// 规则1:寻找红色像素聚集区域(简化为中心区域统计)

int red_pixel_count = 0;

int center_x = img->width / 2;

int center_y = img->height / 2;

int roi_radius = (img->width < img->height ? img->width : img->height) / 4; // 感兴趣区域半径

for (int y = center_y - roi_radius; y < center_y + roi_radius; ++y) {

for (int x = center_x - roi_radius; x < center_x + roi_radius; ++x) {

if (x < 0 || x >= img->width || y < 0 || y >= img->height) continue;

uint16_t pixel = img->data[y * img->width + x];

uint8_t r, g, b;

rgb565_to_rgb(pixel, &r, &g, &b);

// 简单的红色判断:R值高,G和B值低

if (r > 200 && g < 100 && b < 100) {

red_pixel_count++;

}

}

}

int roi_area = (2 * roi_radius) * (2 * roi_radius);

float red_ratio = (float)red_pixel_count / roi_area;

// 规则2:红色像素占比超过阈值(这是我们从“知识”中提取的量化规则)

if (red_ratio > 0.3) { // 阈值0.3来自离线分析

// 这里可以进一步添加形状判断(如计算红色区域的质心和惯性矩,判断是否接近圆)

// 为了示例简化,我们假设红色聚集就意味着“圆形物体”

return DETECT_RED_CIRCLE;

}

return DETECT_NOTHING;

}

// file: main.c (单片机主程序示例)

#include "simple_ai_detector.h"

#include "camera_driver.h" // 假设的摄像头驱动

#include "uart_driver.h" // 串口驱动,用于输出结果

// 图像缓冲区

#define IMG_WIDTH 160

#define IMG_HEIGHT 120

uint16_t image_buffer[IMG_WIDTH * IMG_HEIGHT];

int main(void) {

// 硬件初始化

uart_init(115200);

camera_init(IMG_WIDTH, IMG_HEIGHT);

image_t current_image;

image_init(¤t_image, image_buffer, IMG_WIDTH, IMG_HEIGHT);

while (1) {

// 1. 捕获一帧图像

if (camera_capture_frame(image_buffer) == SUCCESS) {

// 2. 调用我们的“轻量级AI”函数进行检测

detection_result_t result = detect_red_circle(¤t_image);

// 3. 输出结果

switch (result) {

case DETECT_RED_CIRCLE:

uart_send_string("识别结果:检测到红色圆形物体\r\n");

break;

case DETECT_NOTHING:

uart_send_string("识别结果:未发现目标\r\n");

break;

default:

uart_send_string("识别结果:处理错误\r\n");

break;

}

}

// 延时或等待下一帧

delay_ms(1000);

}

return 0;

}

这个框架非常原始,但它清晰地展示了将“AI规则”嵌入C语言项目的流程:定义数据结构 -> 实现特征提取 -> 编码判断规则 -> 集成到主循环。

3. 从构想到实践的挑战与应对

当然,上面的例子是“玩具级”的。真正想做一个有用的功能,你会遇到不少挑战:

- 特征工程是核心难点:如何从大模型中提炼出有效、鲁棒、且易于用C语言计算的特征?这需要你对图像处理和你的目标领域有深入理解。可能需要结合传统计算机视觉方法,如HOG(方向梯度直方图)、LBP(局部二值模式)的简化版。

- 规则复杂度与系统资源平衡:规则越多越复杂,识别越准,但计算量越大,内存消耗越多。需要在单片机的计算能力(MHz级别主频,KB级别RAM)和识别精度之间做精心权衡。

- 光照、角度等环境变化:你的规则必须对一定的环境变化具有鲁棒性。在“知识提取”阶段,就要使用包含各种变化的数据集。在C代码中,可能需要引入归一化(如将颜色转换到HSV空间并主要使用H和S分量)或自适应阈值。

- 多类别识别:识别多种物体,规则库会膨胀。可以设计成分级的决策树形式,先用计算量小的规则排除不可能类别,逐步细化。

应对这些挑战,没有银弹。一个实用的建议是:从极其具体的单一场景开始。比如,不是“识别动物”,而是“识别流水线上特定型号的零件是否正面朝上”。场景越具体,规则越容易提炼,C语言实现也越简单。

4. 进阶思考:与“大模型”的协同工作流

这种轻量级嵌入方案,并不是要取代云端大模型,而是形成一种协同:

- 云端训练与更新:当需要识别新物体或规则效果不佳时,在云端用OFA等大模型重新分析数据,提炼新的或优化旧的规则参数。

- 参数下发:将新的规则参数(可能就是一个包含了几十个阈值和权重的配置文件)通过OTA(空中下载)或串口下发到单片机。

- 边缘端执行:单片机加载新的参数,依然运行那套固定的C语言特征提取和判断逻辑,但判断标准已经更新,从而实现了“模型”的更新。

这种模式既利用了大模型的强大认知能力,又发挥了嵌入式设备实时、低功耗、本地的优势。

5. 总结

回过头看,我们探讨的其实是一种“模型蒸馏后的边缘智能”思路。我们放弃了让单片机运行完整神经网络的幻想,转而寻求一种更务实、更工程化的路径:将AI的“智能”理解为一种可编码的“决策逻辑”,并用嵌入式开发中最熟悉的C语言和单片机去实现它。

这个过程充满了挑战,需要对原始AI模型、图像处理技术和嵌入式开发都有所了解。但它打开了一扇门,让AI不再仅仅是云端的服务,而可以成为你手中那个小小电路板的一部分,去解决一些实实在在的、轻量级的感知问题。

如果你正在为一个单片机项目寻找一点“智能化”的灵感,不妨从这个思路开始。先定义一个非常非常具体的小目标,尝试用最基础的图像处理和逻辑判断去实现它。当你走通这个流程后,你会发现,AI离嵌入式开发,并没有想象中那么遥远。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献34条内容

已为社区贡献34条内容

所有评论(0)