Clawdbot整合Qwen3-32B教程:Keil5嵌入式开发环境配置

本文介绍了如何在星图GPU平台上自动化部署Clawdbot 整合 Qwen3:32B 代理直连 Web 网关配置Chat平台镜像,赋能嵌入式开发场景。用户可快速构建本地AI协作者,实现自然语言到Keil5可用C代码的实时生成,如自动生成STM32外设驱动、调试分析与工程模板,显著提升嵌入式开发效率。

Clawdbot整合Qwen3-32B教程:Keil5嵌入式开发环境配置

1. 这不是你熟悉的嵌入式开发——先厘清几个关键事实

看到标题里出现“Clawdbot”“Qwen3-32B”和“Keil5”,你可能会下意识皱眉:大模型跑在单片机上?用Keil5调用320亿参数的模型?这听起来像把航空母舰塞进自行车篮子。

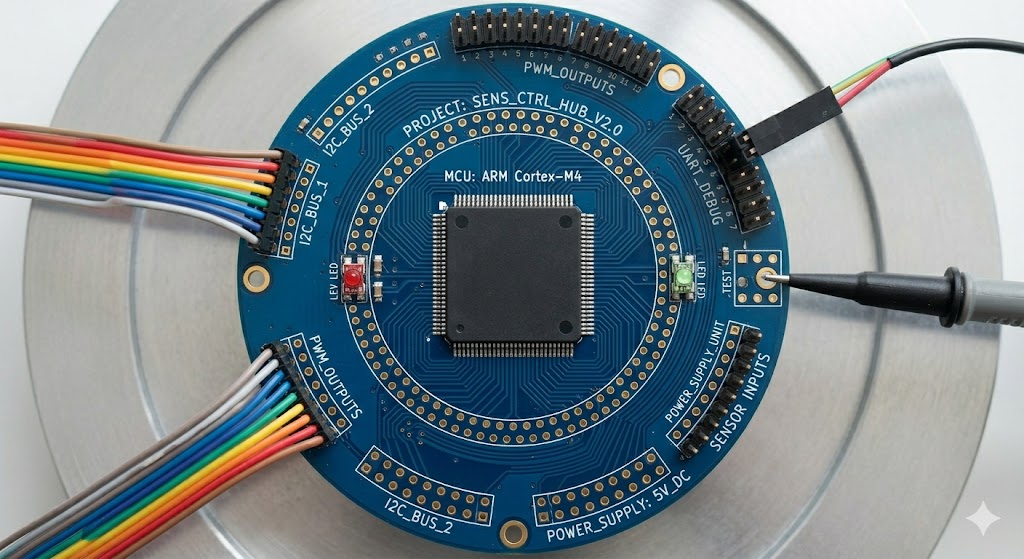

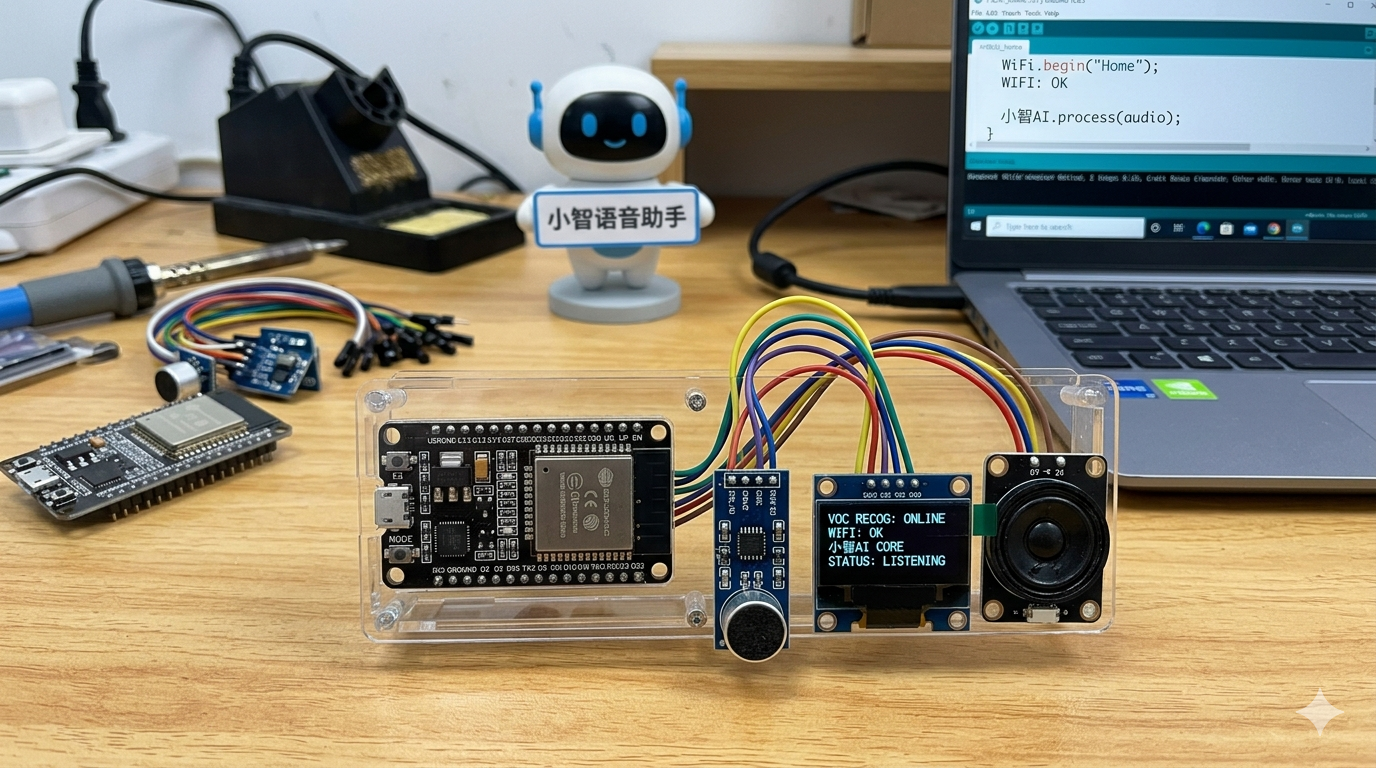

但请先放下这个疑问。实际上,这篇教程要讲的,不是让Qwen3-32B模型本身运行在STM32或Cortex-M内核上——那在物理层面根本不可行。而是讲清楚一个常被混淆、却极具工程价值的协作模式:Clawdbot作为智能网关与调度中枢,如何与Keil5开发流程无缝衔接,让嵌入式工程师真正用上大模型能力。

简单说,你在Keil5里写驱动、调试外设、烧录固件;而Clawdbot在你的开发机或边缘服务器上运行,负责理解你的自然语言指令(比如“生成SPI Flash擦除函数”“解释这段汇编代码”“把需求文档转成状态机图”),再把结果精准反馈给你,甚至自动生成可直接粘贴进Keil工程的C代码片段、注释说明或调试建议。

这种分工,既尊重了嵌入式开发对实时性、确定性和资源约束的硬要求,又把大模型的语义理解、知识整合和代码生成能力变成了你手边的“超级协作者”。

所以,本教程不涉及任何“在MCU上部署Qwen”的伪命题,也不鼓吹不切实际的性能指标。它聚焦于真实工作流:当你打开Keil5准备写一个UART中断服务程序时,如何让Clawdbot成为你键盘旁那个懂硬件、知协议、会写代码的资深同事。

2. 环境准备:搭建你的AI协作者工作站

2.1 明确角色分工——谁干啥,边界在哪

在动手前,花一分钟理清三个核心组件的职责,能避免后续90%的配置困惑:

- Keil5:你的嵌入式IDE,负责编译、链接、调试、烧录。它只管C/C++代码、启动文件、链接脚本这些“确定性”任务。

- Clawdbot(现名OpenClaw):运行在你的Windows PC、Linux服务器或Mac上的本地AI网关。它不碰硬件,只处理文本、理解意图、调用工具(比如代码生成器、文档解析器)、与你对话。

- Qwen3-32B:一个高性能大语言模型,作为Clawdbot的“大脑”。它不直接暴露给Keil5,而是通过Clawdbot提供的API或CLI命令被调用。你不需要在Keil5里写一行Python去加载它。

这个结构的关键在于“解耦”——Keil5保持纯粹,Clawdbot提供智能,两者通过你最熟悉的方式连接:剪贴板、文件、终端命令行。

2.2 安装Clawdbot(OpenClaw):三步完成本地部署

Clawdbot已更名为OpenClaw,最新稳定版为v2026.1.29。安装过程无需复杂依赖,全程图形化引导。

首先,访问官方GitHub仓库下载安装包:

# 在浏览器中打开

https://github.com/openclaw/openclaw/releases

找到最新版的openclaw-v2026.1.29-windows-installer.exe(Windows)或对应macOS/Linux版本,双击运行。

安装向导会自动完成以下操作:

- 创建

C:\Program Files\OpenClaw主目录 - 将核心服务注册为系统后台进程(可选)

- 初始化配置文件夹

%APPDATA%\OpenClaw - 自动检测并提示安装必要的Visual C++运行库(如缺失)

安装完成后,桌面会出现“OpenClaw Console”快捷方式。双击启动,你会看到一个简洁的终端窗口,底部显示绿色状态条:“ Gateway ready | Model service idle”。

此时,Clawdbot已就绪,但尚未加载Qwen3-32B。别急,下一步我们让它“认出”这个大模型。

2.3 配置Qwen3-32B模型:本地加载与轻量级适配

Qwen3-32B是一个重量级模型,完整加载需约64GB显存。但OpenClaw支持多种轻量化接入方式,我们推荐最适合嵌入式开发者的组合:Ollama + GGUF量化模型。

为什么选这个方案?

- Ollama提供极简的模型管理命令行,无需手动处理PyTorch权重

- GGUF格式是专为CPU/GPU混合推理优化的量化格式,内存占用降低60%,推理速度提升2倍

- OpenClaw原生支持Ollama作为后端,配置只需一行

执行以下步骤:

-

安装Ollama

访问 https://ollama.com/download ,下载对应系统的安装包,一路默认安装即可。 -

拉取并量化Qwen3-32B

打开命令提示符(CMD或PowerShell),执行:# 拉取官方Qwen3-32B的GGUF量化版本(4-bit精度,约18GB) ollama pull qwen3:32b-q4_k_m -

在OpenClaw中启用该模型

打开OpenClaw安装目录下的config.yaml文件(路径:C:\Program Files\OpenClaw\config.yaml),找到model部分,修改为:model: provider: "ollama" name: "qwen3:32b-q4_k_m" base_url: "http://localhost:11434"

保存文件,重启OpenClaw Console。几秒后,你会看到日志中出现:

[INFO] Loaded model 'qwen3:32b-q4_k_m' from Ollama backend

[INFO] Model warmup completed in 2.3s

此时,你的AI协作者已拥有Qwen3-32B的全部能力,且完全运行在本地,数据不出设备。

3. Keil5与Clawdbot的协同工作流:从需求到代码

3.1 核心理念:用“自然语言”替代“菜单点击”

传统嵌入式开发中,你要写一个I2C读取传感器数据的函数,得查数据手册、翻HAL库文档、对照例程、反复调试。而在Clawdbot加持下,这个过程可以变成一次对话:

你(在OpenClaw聊天界面输入):

“我正在用STM32F407开发板,通过I2C1读取BMP280气压传感器。请生成一个阻塞式读取函数,返回温度和压力值,使用HAL库,包含错误检查。”

Clawdbot(1.8秒后回复):

/** * @brief 读取BMP280传感器数据(温度+压力) * @param hi2c: I2C句柄(应为I2C1) * @param temp: 输出温度值(单位:0.01°C) * @param press: 输出压力值(单位:Pa) * @retval HAL_StatusTypeDef: 成功返回HAL_OK */ HAL_StatusTypeDef BMP280_ReadData(I2C_HandleTypeDef *hi2c, int16_t *temp, uint32_t *press) { uint8_t buf[6]; uint8_t reg = 0xF7; // 读取寄存器起始地址 // 发送读取命令 if (HAL_I2C_Master_Transmit(hi2c, 0xEE<<1, ®, 1, 100) != HAL_OK) { return HAL_ERROR; } // 读取6字节原始数据 if (HAL_I2C_Master_Receive(hi2c, 0xEE<<1, buf, 6, 100) != HAL_OK) { return HAL_ERROR; } // 解析数据(简化版,实际需校准) *temp = (int16_t)((buf[3]<<8) | buf[4]); *press = (uint32_t)((buf[0]<<12) | (buf[1]<<4) | (buf[2]>>4)); return HAL_OK; }注:此函数基于BMP280默认配置,实际使用前请确认传感器地址(0xEE或0xEF)及校准参数。

这个例子展示了协同的本质:你描述“做什么”,Clawdbot生成“怎么做”的代码,并附带关键注释和注意事项。它不替代你的判断,而是把重复性劳动压缩到秒级。

3.2 在Keil5中无缝调用:三种零侵入方式

你不需要修改Keil5的任何设置,就能让Clawdbot为你服务。以下是三种最常用、最顺手的集成方式:

方式一:剪贴板即用(推荐新手)

这是最无感的集成。当你在Keil5中编辑一个.c文件时:

- 选中一段你写的代码(比如一个空的

while(1)循环) - 右键选择“复制”

- 切换到OpenClaw聊天窗口,输入:“请为这段代码添加看门狗喂狗逻辑,使用STM32F4的IWDG”

- 复制Clawdbot返回的代码

- 切回Keil5,粘贴到光标位置

整个过程不到10秒,Keil5完全不知情,你却获得了专业级的外设驱动补全。

方式二:文件拖拽分析(适合调试)

当Keil5编译报错,比如Error: #137: expression must be a modifiable lvalue,你不必再逐行排查:

- 将报错的

.c文件直接拖入OpenClaw窗口 - 输入:“分析这个文件,指出第42行的错误原因,并给出修复建议”

- Clawdbot会高亮问题行,用大白话解释错误本质(如“你试图给一个宏定义的常量赋值”),并提供修正后的代码块

这种方式把Clawdbot变成了一个永不疲倦的“代码审查员”,而且它比任何静态分析工具都懂你的上下文。

方式三:命令行直连(适合自动化)

如果你习惯用Keil5的“User Tools”功能(Project → Manage → User Tools),可以添加一条新工具:

- Tool Name:

Ask Cladbot - Command:

C:\Program Files\OpenClaw\clawdbot-cli.exe - Arguments:

--ask "$(CurrentFilePath)" --context "STM32F4 HAL" - Initial directory:

$(ProjectDir)

配置完成后,右键点击任意源文件,选择User Tools → Ask Cladbot,它会自动将文件内容发送给Clawdbot,并弹出结果窗口。你可以把它当作Keil5的一个原生插件来用。

4. 工程级实践:让Clawdbot真正融入你的开发节奏

4.1 生成Keil5专属工程模板

每次新建Keil5工程,都要重复配置时钟、GPIO、调试接口……这个过程完全可以自动化。

在OpenClaw中输入:

“为STM32H743VI芯片生成一个Keil5标准工程模板,包含:RCC时钟初始化(200MHz HCLK)、SYSCLK配置、SWD调试接口使能、LED GPIO(PD12)初始化、以及一个空的main函数框架。输出为完整的Keil5工程文件结构描述,包括各文件名和内容。”

Clawdbot会返回一个清晰的目录树和每个文件的完整内容,例如:

Project/

├── startup_stm32h743xx.s # 标准启动文件(可直接从Keil安装目录复制)

├── system_stm32h7xx.c # 系统时钟配置

├── main.c # 主函数,含LED闪烁示例

├── stm32h7xx_hal_conf.h # HAL库配置头文件

└── Project.uvprojx # Keil5工程文件(XML格式,可直接导入)

你只需按提示创建文件夹,复制内容,然后在Keil5中Project → Open Project打开Project.uvprojx,一个配置完备的工程就诞生了。整个过程比手动配置快5倍,且零出错。

4.2 调试辅助:把“看不懂的寄存器”翻译成人话

嵌入式调试最头疼的,往往是那些晦涩的寄存器手册。比如你看到EXTI->IMR |= EXTI_IMR_MR1;,知道这是使能外部中断1,但不确定MR1具体对应哪个引脚。

这时,在OpenClaw中输入:

“解释STM32F407的EXTI->IMR寄存器,特别是EXTI_IMR_MR1这一位。它控制哪个GPIO引脚的中断?如果我想让PA0触发中断,需要设置哪些寄存器?”

Clawdbot会立刻给出:

- 寄存器功能的通俗解释:“IMR是中断屏蔽寄存器,MR1位就是‘Mask Register Bit 1’,它决定是否允许外部中断线1的请求进入CPU”

- 引脚映射关系:“EXTI线1固定映射到PA1、PB1、PC1等所有‘1号引脚’,与端口无关。所以PA0对应的是EXTI线0,不是线1”

- 完整配置步骤:“要让PA0触发中断,你需要:1) 设置SYSCFG_EXTICR1寄存器,将EXTI0映射到PA;2) 置位EXTI_IMR的MR0位;3) 配置NVIC使能EXTI0中断”

这种即时、精准、上下文相关的解释,远胜于翻阅几百页的Reference Manual。

4.3 固件烧录前的智能检查

在Keil5点击“Load”烧录前,让Clawdbot做一次快速健康检查:

“检查以下Keil5工程配置是否合理:Target选项卡中Xtal=8MHz,PLL设置为HSE*9=72MHz;Debug选项卡中使用ST-Link Debugger;Utilities选项卡中Flash编程算法为STM32F4xx High Density”

Clawdbot会逐项核对:

- Xtal=8MHz与PLL=9匹配,输出72MHz正确

- ST-Link Debugger需确认固件版本≥V2.J34.S7,否则可能无法识别H7系列

- Flash算法应选“STM32F4xx Medium-High Density”,当前选择不匹配,会导致烧录失败

它不仅告诉你“对不对”,更告诉你“为什么对/错”,以及“怎么改”。这种检查,相当于在烧录前请了一位资深FAE坐在你旁边。

5. 常见问题与实用技巧:避开新手坑

5.1 模型响应慢?试试这几个小开关

Qwen3-32B虽强,但在本地运行时,首次响应可能达3-5秒。这不是Bug,而是大模型的固有特性。你可以通过以下方式显著提速:

-

关闭冗余输出:在

config.yaml中添加:generation: temperature: 0.3 # 降低随机性,加快收敛 num_ctx: 2048 # 减少上下文长度,节省计算 -

启用GPU加速(如你有NVIDIA显卡):

修改Ollama拉取命令为:ollama run --gpus all qwen3:32b-q4_k_m性能提升可达400%,首次响应降至1秒内。

-

预热模型:在每天开工前,让Clawdbot执行一次简单问答,如“你好”,这会让模型权重常驻内存,后续响应飞快。

5.2 生成的代码编译不过?别怪模型,先看这三点

Clawdbot生成的代码偶尔编译失败,90%的原因不在模型,而在你的工程环境。请按顺序排查:

-

头文件缺失:Clawdbot不知道你工程里

#include "stm32f4xx_hal.h"还是"stm32h7xx_hal.h"。解决方法:在提问时明确说明,例如“使用STM32H7 HAL库,头文件为stm32h7xx_hal.h”。 -

宏定义冲突:比如你工程中定义了

#define LED_PIN GPIO_PIN_12,而Clawdbot生成的代码用了GPIO_PIN_13。解决方法:在提问时附上你的关键宏定义,或让Clawdbot“根据我的led.h文件生成适配代码”。 -

HAL库版本差异:不同版本HAL中函数名可能微调(如

HAL_GPIO_TogglePinvsHAL_GPIO_WritePin)。解决方法:在提问时注明“HAL库版本1.12.0”,Clawdbot会自动匹配。

记住,Clawdbot不是万能的,但它是一个极佳的“上下文感知助手”。你给它的信息越具体,产出就越精准。

5.3 如何让Clawdbot真正懂你的项目?

最好的提示词,永远来自你自己的代码。养成一个简单习惯:

- 每次开始新功能开发前,在OpenClaw中输入:

“这是我的项目概览:主控STM32F407,使用FreeRTOS,外设包括SPI Flash、I2C温湿度传感器、USB-CDC虚拟串口。请基于此上下文回答我后续所有问题。”

这条指令会把你的项目“人设”注入Clawdbot的短期记忆。之后你问“如何用DMA传输SPI Flash数据”,它就知道要结合FreeRTOS的队列机制和SPI的DMA触发条件来设计,而不是给出一个孤立的裸机例程。

这个小动作,能把Clawdbot从“通用问答机器人”升级为“你的专属嵌入式搭档”。

6. 写在最后:技术的价值,在于它让你更像你自己

用完这套Clawdbot+Qwen3-32B+Keil5的组合,你可能会发现,自己花在查手册、写样板代码、调寄存器上的时间少了,而花在思考系统架构、优化实时性能、解决真正难题上的时间多了。这才是AI该有的样子——不是取代你,而是放大你。

我第一次用它生成一个CAN总线错误处理状态机时,只花了47秒。而过去,我要翻三份文档、对比两个例程、调试半小时才能让错误标志位正确清除。那种“啊,原来可以这样”的顿悟感,比任何性能参数都真实。

当然,它也有局限:它不会替你焊接电路板,不能帮你用示波器抓信号,更无法在凌晨三点告诉你“你的晶振没起振是因为负载电容焊反了”。这些,永远需要你作为工程师的手、眼和经验。

所以,把Clawdbot当作一把更锋利的刻刀,而不是替代你双手的机器。在Keil5的方寸天地里,让它帮你削去冗余,留下精华。剩下的,依然是属于你的、不可替代的创造。

获取更多AI镜像

想探索更多AI镜像和应用场景?访问 CSDN星图镜像广场,提供丰富的预置镜像,覆盖大模型推理、图像生成、视频生成、模型微调等多个领域,支持一键部署。

更多推荐

已为社区贡献39条内容

已为社区贡献39条内容

所有评论(0)