【全志开发板部署】系列0:LPRNet模型简要说明

《LPRNet:基于全卷积网络的无分割车牌识别方法》提出了一种轻量级端到端车牌识别方案,其核心创新在于:1)首次采用纯卷积结构(不含RNN)实现实时识别,计算量仅0.34GFLOPs;2)通过CTCLoss直接处理变长车牌,支持复杂格式(如中国车牌);3)结合全局上下文模块增强特征表达。该网络在94×24像素输入下达到95%准确率,CPU推理仅1.3ms/张,并创新性地采用两阶段训练策略(先收敛识

·

论文背景

《LPRNet:基于深度神经网络的车牌识别》作者来自Intel,提出了一种无需字符分割、端到端、实时运行的轻量级卷积神经网络LPRNet。

论文核心贡献

- 首创无RNN的实时车牌识别:LPRNet首次证明了可以不依赖循环神经网络(RNN/LSTM),仅用全卷积网络(FCN)实现端到端车牌识别,极大降低了计算复杂度(单次推理仅0.34 GFLOPs)。

- 支持变长车牌:通过CTC Loss直接处理不定长字符序列,无需固定车牌长度,适用于各国不同格式-车牌(特别是字符复杂的中国车牌)。

- 高准确率+实时性能:在中国车牌数据集上达到95%准确率,在Intel i7-6700K CPU上仅需1.3ms/张,GTX 1080 GPU上仅需3ms/张。

模型主干

- Backbone网络

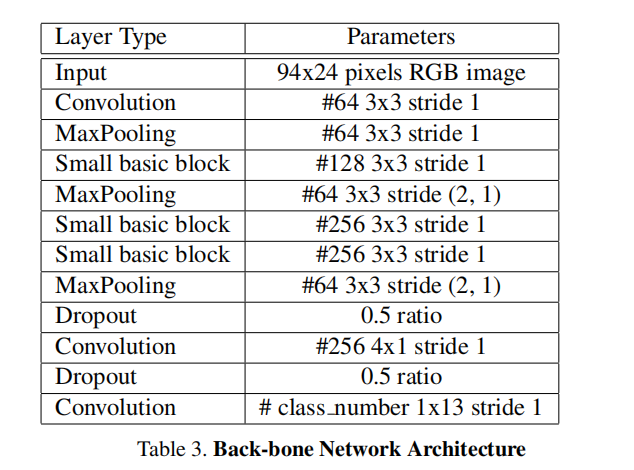

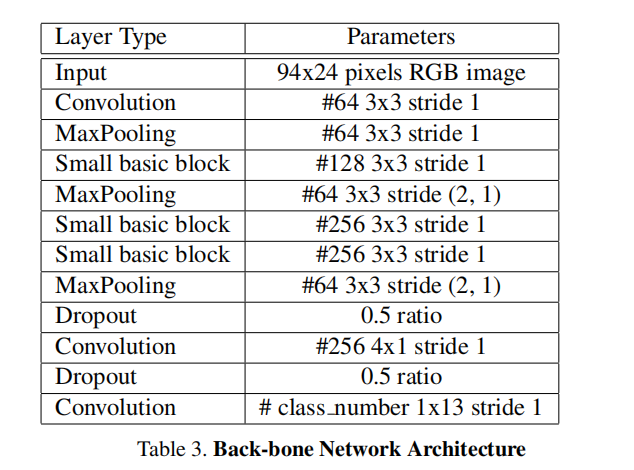

- 输入:94×24像素的RGB车牌图像

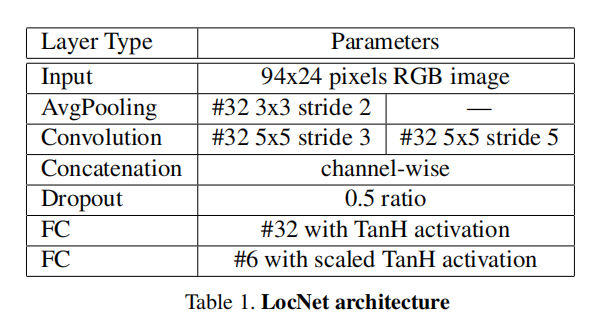

- 首先,输入图像会经过空间变换器层的预处理该步骤虽非必需,但有助于探索如何对输入图像进行变换以提升其识别特征。为确定最优变换参数,采用了原始LocNet 架构。

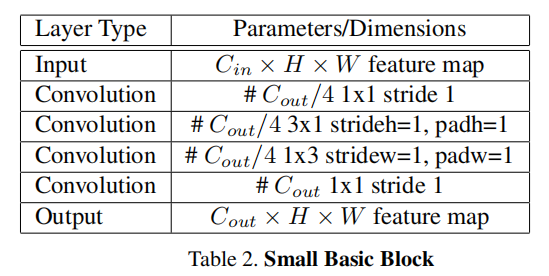

- 核心模块:Small Basic Block

-

- 完整Backbone网络

最后的1×13宽卷积直接捕捉字符横向上下文,替代了LSTM的功能。

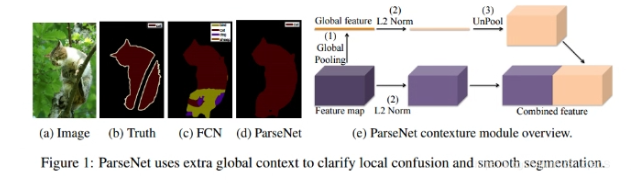

- 全局上下文嵌入(Global Context)

- 对Backbone输出做全局平均池化 → 全连接层 → 得到全局特征向量

- 将该向量平铺并拼接到每个空间位置的特征图上

- 类似ParseNet的思想,弥补局部感受野的不足

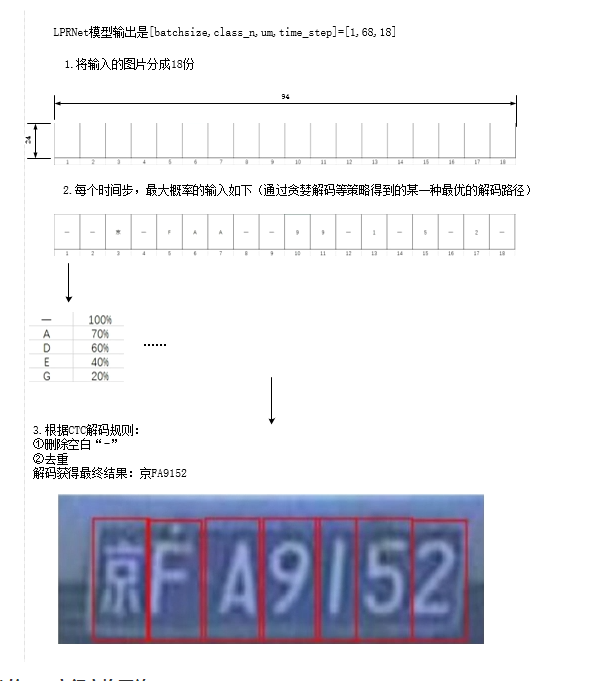

- CTC Loss

- 解决的问题:

长度不匹配:输入图像宽度不固定(如车牌变形、拍摄距离变化),但输出字符序列长度恒为7位

无需字符分割:传统方法需要先定位7个字符区域再分别识别,LPRNet通过CNN直接提取整个车牌特征图,每列对应一个时间步

重复字符处理:车牌中可能出现"AA"、"11"这种连续相同字符,CTC通过blank符号,考虑所有可能的字符对齐方式,最大化目标字符串的总概率,避免解码歧义 - 例子

使用了blank符号,将下图为例

在解码端,相同的字符进行合并,如果说输出的长度是[]京[]FF[]A[]9[]11[]5[]22[],就会等同于上面的京FA9152

推理:使用Greedy Search或Beam Search

- 可选的STN空间变换网络

LocNet预测6个仿射变换参数,对输入图像进行校正

训练技巧:前5k iterations关闭STN,等识别网络初步收敛后再启用,避免梯度异常

效果:提升2.8-5.2%精度 - 后处理(Post-filtering)

基于国家车牌模板规则(如"京X·XXXXX"格式)过滤非法结果

仅与Beam Search配合使用,从Top-N候选中筛选首个合法字符串

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)